现今社交媒体有一项很大的问题,虽然说照片可以随意分享,不过不是所有照片内容都适于任何的年龄。现在Meta宣布Instagram正测试可过滤未成年用户通过私讯收到色情照片功能。

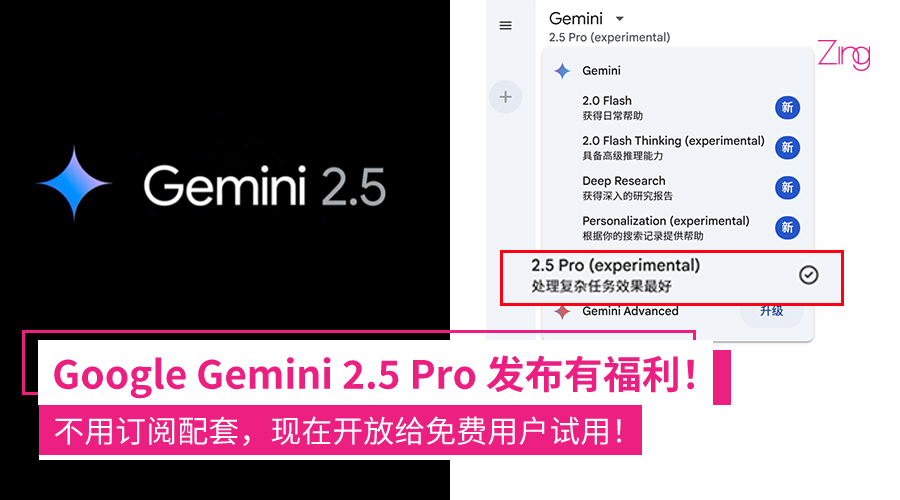

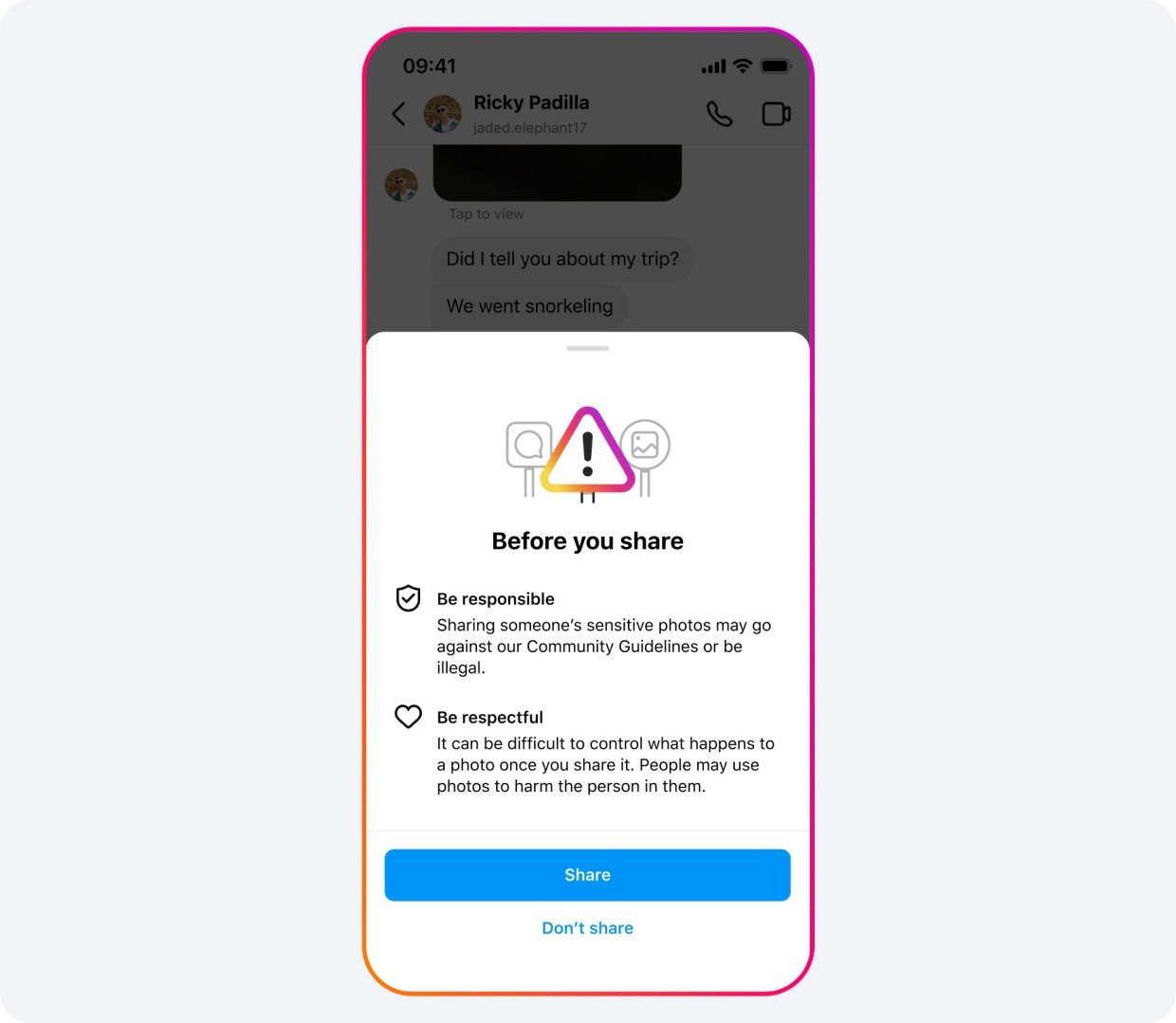

一旦 Instagram 发现和色情照片一致,默认情况下会用标签遮盖,表示它可能包含用户不希望看到的内容。

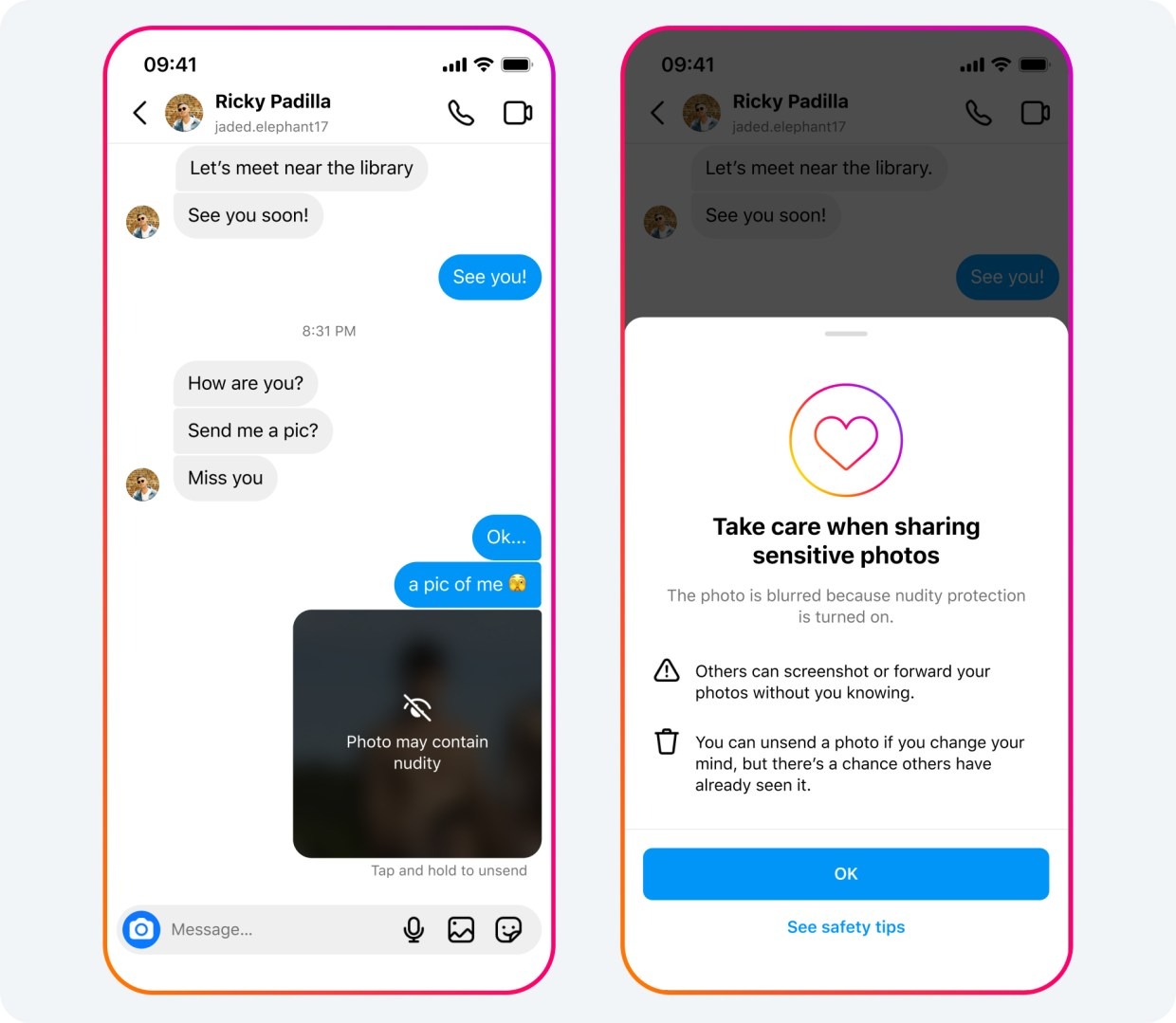

除了收件人之外,如果 Instagram 检测到他们正在发送色情图片,发件人也会收到包含建议和安全秘诀的信息,之后可以删除已发送的图像。

Meta表示,最新的AI防裸工具是基于公司长期致力于保护年轻人免受不必要或潜在有害接触的努力而推出的。目前正在测试这一新功能,旨在帮助保护年轻人免受性勒索和亲密图像泄露等伤害,同时使潜在的诈骗者和罪犯更难以接触和互动青少年。

性勒索也包含说服用户在网上发送露骨的照片,然后威胁要公开这次图片以向受害者索取钱财或提供性服务。

目前在大马,已有好几宗类似的敲诈勒索案,因此作为父母和监护人也具有一定的挑战,而随着Instagram之后推出这个功能后相信类似案件也会少一些。

Source :