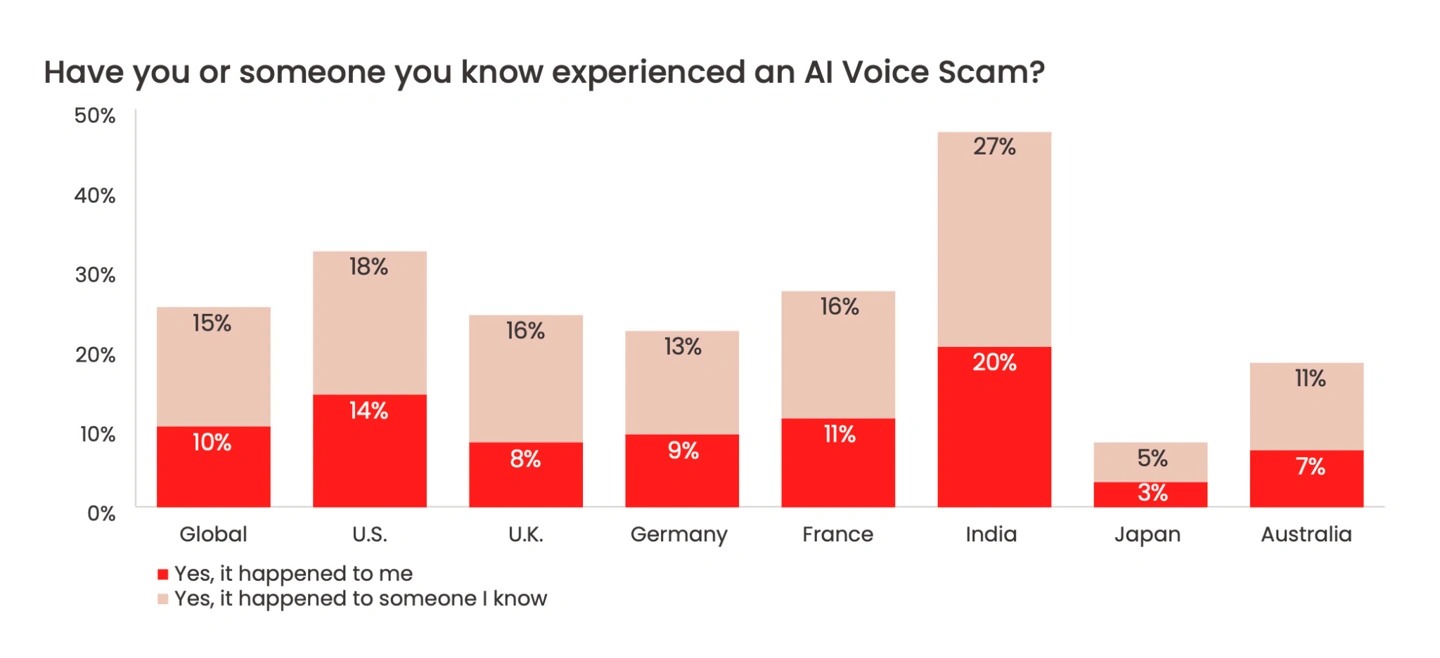

AI不仅仅能力强大,用于诈骗也是势不可挡,根据McAfee的自信报告指出,基于AI的语音诈骗越来越猖獗,有77%的人会因此中招,被骗钱的几率提升不少!

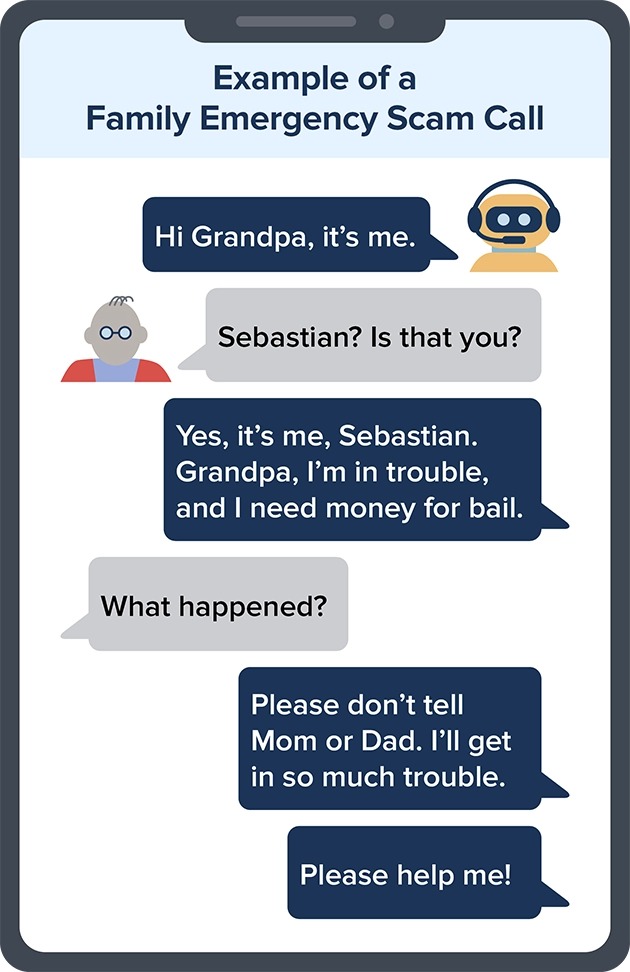

根据McAfee举出的例子,其中一个AI透过模拟亲人的方式去要钱,实际套路其实也变化不大,不外乎就是“我进监牢了快保释我”或是“我被绑架了快付赎金”的套路,不过这次更厉害的是能够复制模仿亲属的声音,像得维俏维妙的时候就很容易上当了。

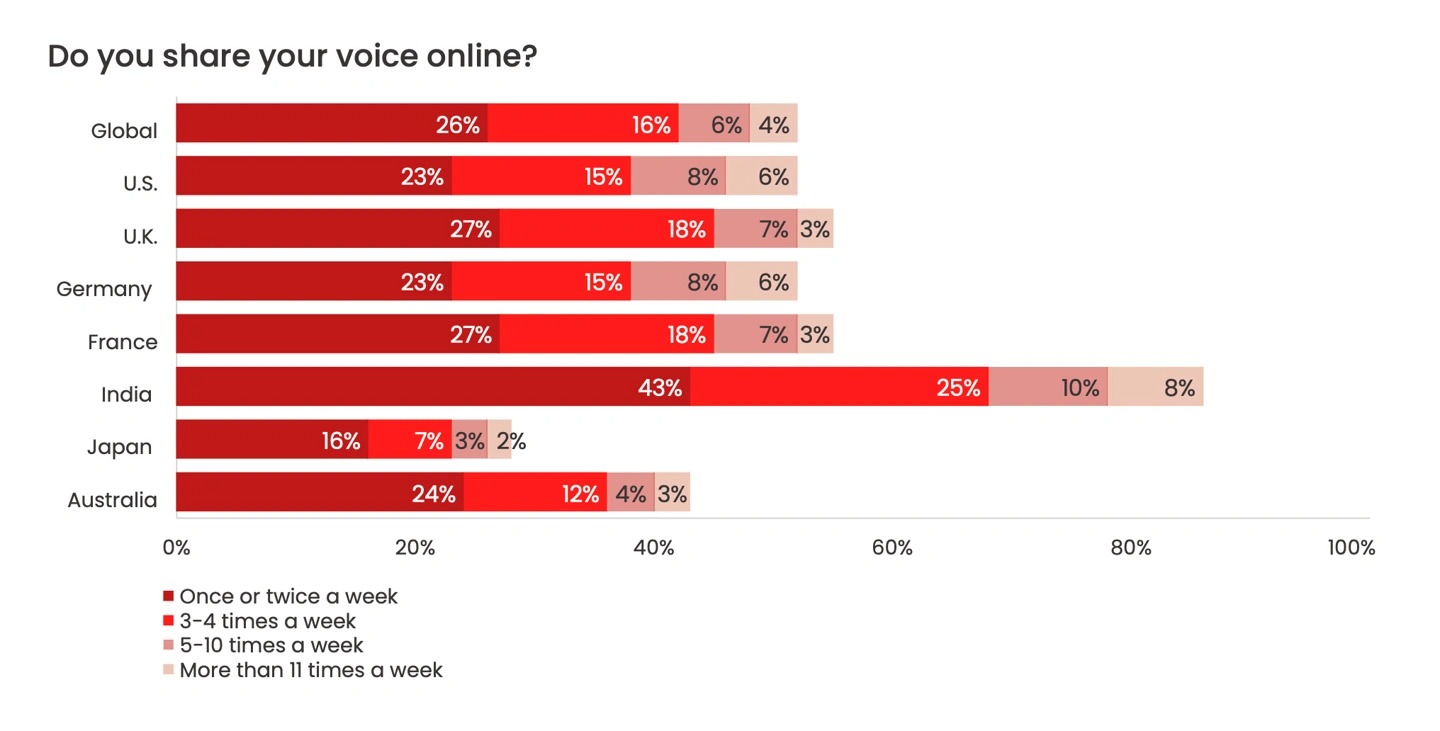

那么,AI是怎么模仿你的声音的呢?据了解,他们是从社交媒体上的声音内容做为样本去模仿,不管你是拍短视频还是放个Story,如果出现记得声音都有可能被AI学习并复制声音,只要你分享的声音越多就更容易被复制了。

报告中提到,AI在2022年就承购窃取了26亿美元,有77%接到AI诈骗电话的人都会出现经济损失,而AI语音复制的精确度高达95%。更多报告的详情可以到这个链接了解更多。

延伸阅读:

MICROSOFT首席经济学家警告:AI一旦落入坏人之手,将造成真正的破坏!